Essai : L’épreuve de la preuve

"Des affirmations extraordinaires exigent des preuves extraordinaires"

Le célèbre astrophysicien Carl Sagan a formulé cet axiome en référence aux PAN (Phénomènes Aérospatiaux Non identifiés) et aux éventuelles visites d’intelligences non humaines. Il pose une exigence légitime de rigueur scientifique, sans définir précisément ce qui constitue des preuves extraordinaires. Cependant, l’épistémologie nous enseigne que de nombreuses avancées majeures sont dues à une ouverture d’esprit et une curiosité hors du commun. Les découvertes exceptionnelles exigent également une ouverture d’esprit exceptionnelle.

Dans le premier article de cette série, nous avons établi que le Département de la Guerre (anciennement Département de la Défense ou DOD) américain avait officiellement reconnu l’existence des PAN à travers un rapport de l’ODNI (Office of the Director of National Intelligence) publié en 2021. Cette reconnaissance marque une rupture profonde après des décennies de déni et de stigmatisation. Ce document, intitulé Preliminary Assessment: Unidentified Aerial Phenomena, atteste que des phénomènes aérospatiaux non identifiés sont observés et pris au sérieux par des instances officielles. Leur nature ou origine, qu’elle soit humaine ou non humaine, reste totalement indéterminée.

Mais qu’est-il à prouver, exactement ?

Que le phénomène ne correspond à aucun processus naturel connu ?

Qu’il émane de percées technologiques gardées secrètes par un ou plusieurs gouvernements ?

Qu’il manifeste la présence sur Terre d’une intelligence non humaine ?

Ou encore qu’il n’y a rien à expliquer car il s’agit d’une construction culturelle ou perceptive ?

Le concept de preuve semble aller de soi, mais il s’appuie sur une construction complexe. Avant même de définir la nature des preuves à rechercher, il est nécessaire de comprendre ce que nous acceptons comme tel et selon quels critères. Or, ce que nous considérons comme probant dépend de nos capacités perceptives, de nos cadres épistémologiques, de nos normes culturelles et scientifiques, des outils technologiques dont nous disposons ainsi que de l’état actuel de nos connaissances.

Pour illustrer cette complexité, imaginons le scénario suivant. Le président des États-Unis convoque une conférence de presse exceptionnelle et annonce détenir des preuves qu’une intelligence non humaine interagit avec la Terre et ses habitants. Il présente alors une vidéo d’une qualité remarquable montrant un objet sans ailes ni système de propulsion apparent sortir de l’océan, puis effectuer une série de manœuvres défiant les lois de la physique connues, sans émettre aucun son. L’objet se pose ensuite sur la rive et plusieurs êtres manifestement non humains en descendent. Après la diffusion, il révèle un rapport d’institutions scientifiques officielles comportant des données censées valider ses affirmations.

Un tel événement suffirait-il à engager un changement de paradigme ? Probablement pas, et pour de bonnes raisons.

La vidéo pourrait être une fabrication réalisée grâce à l’intelligence artificielle ou relever d’une campagne de désinformation. L’épisode des prétendues armes de destruction massive en Irak illustre comment des autorités gouvernementales peuvent présenter de fausses preuves en s’appuyant sur la confiance accordée à leurs institutions. En 2003, Colin Powell brandissait devant l’ONU une fiole censée contenir de l’anthrax irakien, échantillon qui s’avéra être un faux, à l’image des armes biologiques qu’il était censé prouver. Cette manipulation visait à convaincre l’opinion publique et la communauté internationale de la nécessité d’envahir l’Irak.

Dans notre illustration fictive, un rapport doté du sceau gouvernemental ne saurait constituer une preuve irréfutable. La science fonctionne par consensus, validation collective et reproductibilité. Il faudrait que les échantillons de l’engin et des analyses biologiques des occupants, ainsi que les méthodes et protocoles utilisés, soient mis à disposition de la communauté scientifique mondiale pour des études indépendantes. Ce processus de confirmation ou d’invalidation par des laboratoires du monde entier pourrait prendre des mois, voire des années.

Les seules preuves véritablement acceptables résulteraient de cette démarche scientifique internationale, établissant par exemple que les matériaux de l’engin présentent des ratios isotopiques incompatibles avec l’ensemble des processus naturels et industriels connus, que son système de propulsion défie les lois physiques établies, ou que des entités non humaines présentent un système biochimique ou génétique inconnu de la science.

Cet exemple illustre la complexité fondamentale de la notion de preuve lorsqu’elle s’applique aux phénomènes aérospatiaux non identifiés. Or, pour saisir ce que notre esprit accepte comme valide, il faut d’abord examiner les filtres à travers lesquels nous interprétons le monde.

Nos sens, filtres de réalité

Une preuve, dans son sens courant, est ce qui établit une vérité, ce qui confirme qu’un fait est réel. Or la réalité n’est pas un absolu universel. Elle est subjective et se construit à travers nos outils perceptifs limités, qu’ils soient naturels ou fabriqués. Ce que nous appelons réel est donc intrinsèquement lié à ce que nous sommes capables de percevoir.

Chez les animaux, les modalités sensorielles sont parfois radicalement différentes des nôtres. Un chien possède par exemple un odorat jusqu’à 100 000 fois plus sensible que celui d’un humain. Un aigle repère un lapin à plus de quatre kilomètres. Un requin peut détecter une goutte de sang diluée dans l’équivalent d’une piscine.

Ces êtres vivent dans le même univers que le nôtre, mais leur perception recompose ce monde autrement pour créer une réalité fondamentalement différente.

De plus, au sein d’une même espèce, les réalités ne sont pas uniformes.

Une personne voyante et une personne aveugle de naissance ne construisent pas leur rapport à l’espace de la même manière.

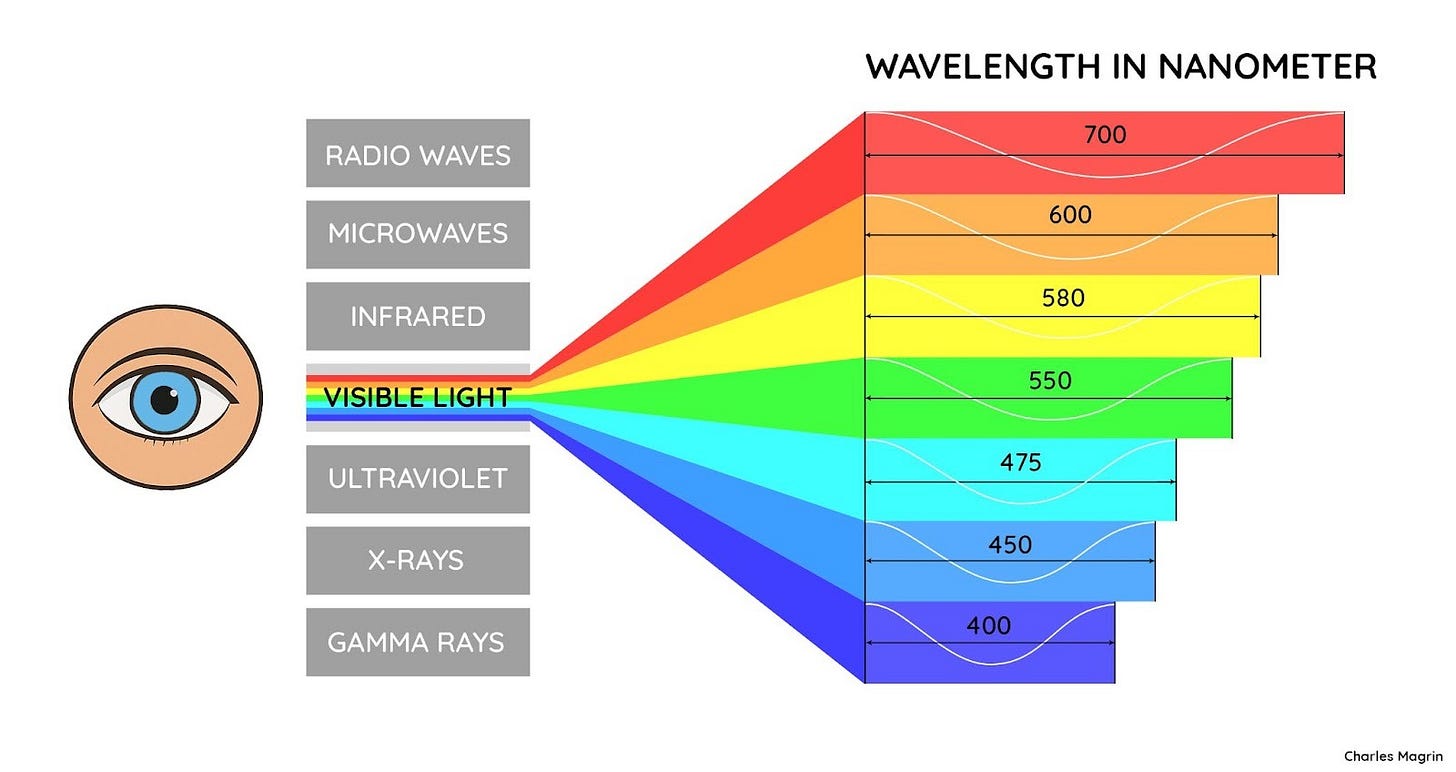

En outre, notre vision ne capte qu’une infime portion du réel. Elle se limite à une étroite bande du spectre électromagnétique, comprise entre 400 et 700 nanomètres environ, soit moins d’un milliardième du spectre connu, qui s’étend de quelques picomètres (rayons gamma) à plusieurs kilomètres (ondes radio). Par ailleurs, ce que nous appelons “couleurs” n’est que le fruit de l’interprétation par notre cerveau de différentes fréquences du spectre électromagnétique. Les couleurs ne constituent donc pas des propriétés objectives ni intrinsèques à ce rayonnement.

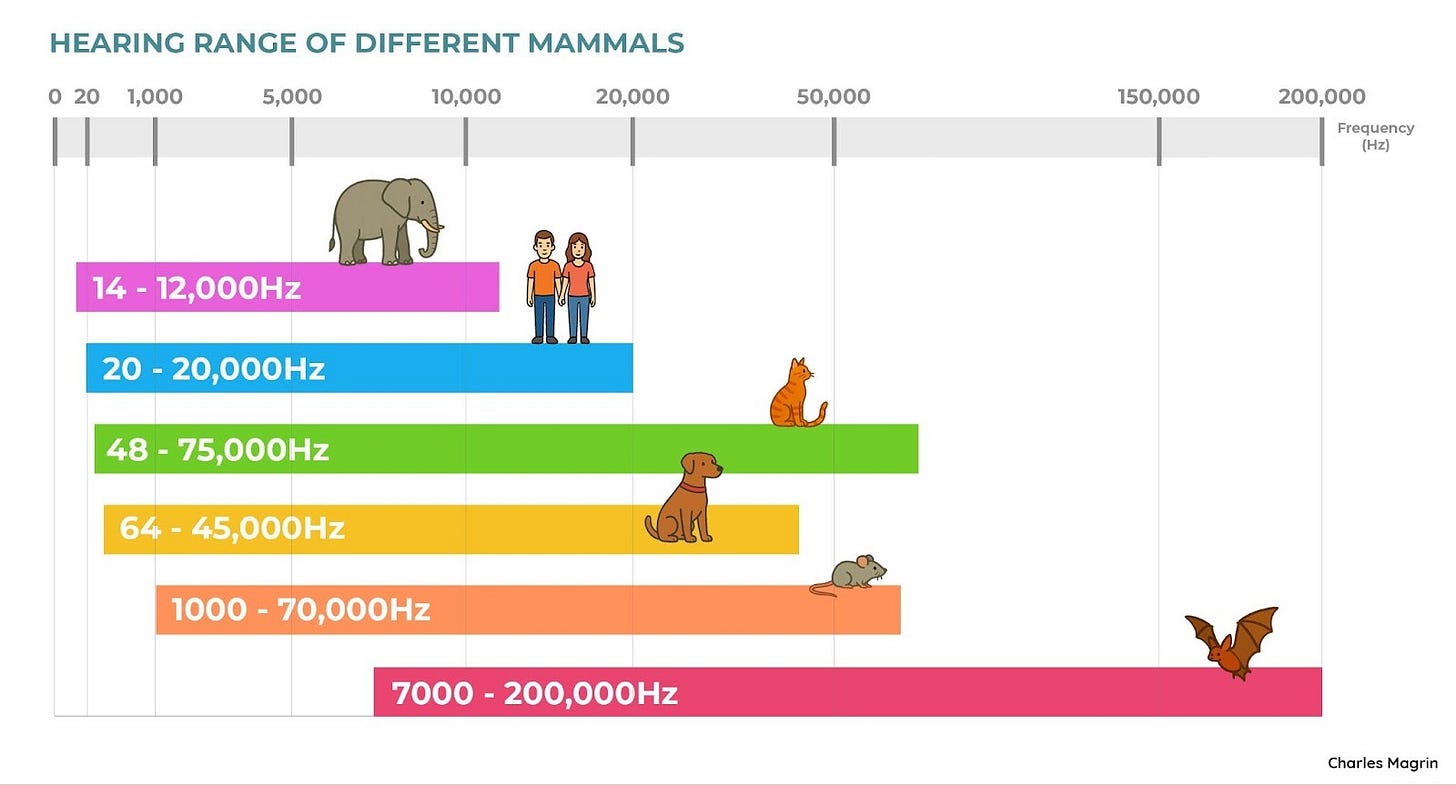

Notre ouïe, elle aussi, est limitée à une plage de fréquences comprise entre 20 et 20 000 hertz, tandis que le spectre sonore étudié par la science s’étend d’environ 1Hz à plus de 10Ghz, soit environ 500 000 fois plus large que notre plage audible.

Nous évoluons donc parmi des océans de signaux, mais notre perception n’en effleure que les rivages.

Le cerveau, architecte de notre perception

Si nos sens ne captent qu’une fraction des signaux bruts présents dans notre environnement, ce que nous percevons consciemment est plus restreint encore. Selon les travaux de Timothy D. Wilson (2002), nos sens enverraient environ 11 millions de bits d’informations par seconde à notre cerveau, or notre conscience n’en traiterait que 40 à 50 bits par seconde.

Ce tri drastique est permis par un processus neurologique automatique appelé filtrage sensoriel. Il agit comme une barrière interne, inhibant ou diminuant les stimuli jugés non pertinents afin de préserver notre stabilité cognitive. Autrement dit, 99,9996 % de l’information captée est écartée et seulement 0,0004 % atteint notre conscience.

Imaginez une immense bibliothèque dans laquelle 11 millions de nouveaux livres arrivent chaque seconde et où l’unique super-bibliothécaire ne peut en trier qu’une quarantaine à chaque instant !

Le rôle de l’attention sélective dans l’expérience subjective de la réalité

Le tri sensoriel ne constitue qu’une des premières étapes du traitement de l’information. Une fois filtrés, les signaux retenus sont organisés par le cerveau en une représentation cohérente et utilisable. Ce processus est dynamique et orienté par plusieurs facteurs cognitifs.

L’attention joue un rôle central dans notre perception du monde. Elle agit comme un filtre actif, orientant ce que nous remarquons et ce que nous laissons de côté, souvent sans en avoir conscience. Ce processus est influencé par plusieurs variables : nos attentes orientent notre vigilance, nos émotions amplifient certains signaux, notre culture façonne ce à quoi nous prêtons attention, et le contexte immédiat module constamment notre champ perceptif.

Pour en prendre conscience de manière concrète, une célèbre expérience de psychologie cognitive propose un petit défi d’observation. Elle dure moins de deux minutes. Visionnez-la avant de lire la suite.

THE MONKEY BUSINESS ILLUSION

Si vous avez participé à l’expérience, vous avez peut-être été surpris par ce que vous n’avez pas vu. Cette démonstration illustre avec force le fait que notre attention structure profondément notre perception consciente mais en limite aussi le champ. Ce que nous voyons peut donc être très éloigné de ce qui s’est réellement produit.

Perception bayésienne : quand le cerveau devance le monde

La perception repose notamment sur un mécanisme prédictif. Le cerveau ne se contente pas d’analyser ce qui vient des sens, il anticipe. Il génère en permanence des hypothèses sur ce que nous allons percevoir, puis ajuste ces prédictions à la lumière des erreurs entre ce qui était attendu et ce qui est perçu. Ce modèle, souvent qualifié de bayésien, est aujourd’hui largement adopté dans les sciences cognitives, bien que certains aspects de sa portée ou de ses mécanismes fassent encore débat.

Ce processus nous permet d’agir rapidement dans un environnement complexe, mais il peut aussi engendrer des illusions, des distorsions ou des croyances erronées lorsque le signal est ambigu, inattendu ou insuffisant.

Biais cognitifs, distorsions et illusions collectives

De nombreux processus cognitifs peuvent également influencer notre façon de percevoir, de mémoriser et d’interpréter les événements. Les recherches en psychologie cognitive ont identifié de nombreux biais cognitifs affectant systématiquement nos jugements et nos perceptions. Cette ampleur témoigne de l’étendue des mécanismes par lesquels notre esprit déforme, filtre ou réinterprète la réalité. La liste qui suit ne prétend pas à l’exhaustivité, mais illustre quelques-uns des biais et phénomènes les plus documentés, dont les effets peuvent se combiner voire s’amplifier.

Biais de confirmation

Tendance à privilégier les informations qui confirment nos croyances préalables, tout en ignorant ou discréditant celles qui les contredisent.

Exemple : un observateur convaincu que les PAN sont d’origine non humaine pourra interpréter toute lumière inhabituelle comme une preuve allant dans ce sens, même en l’absence de corrélats objectifs.

Effet de vérité illusoire

Un énoncé répété de manière fréquente, notamment dans les médias ou les réseaux sociaux, tend à être perçu comme plus crédible, même s’il est factuellement erroné.

Exemple : l’idée que nous n’utilisons que 10% de notre cerveau, répétée dans de nombreux films et articles, est largement acceptée malgré son caractère scientifiquement infondé.

Paréidolie

Notre cerveau cherche en permanence des formes connues dans ce qui est ambigu ou inachevé. Cette capacité de reconnaissance rapide a sans doute une valeur adaptative, mais elle peut aussi nous induire en erreur. Les neurosciences montrent que notre cerveau favorise particulièrement la détection de visages, une capacité cruciale pour la survie et la socialisation humaine. Cette prédisposition évolutive explique notre tendance à reconnaître des visages dans des formes ambiguës, privilégiant l’erreur par excès plutôt que par défaut.

Exemple classique : percevoir une silhouette dans un nuage, ou un visage sur la surface de Mars - comme le célèbre “visage de Cydonia“ identifié par la sonde Viking en 1976, qui s’est révélé être une simple formation rocheuse sous un éclairage particulier.

Un exemple l’illustre parfaitement. En mai 2025, lors d’une conférence publique à Washington, Luis Elizondo a présenté une photo aérienne évoquant un immense objet circulaire. En moins de 24 heures, cette image a été identifiée comme une simple vue de cercles d’irrigation agricoles.

Dans une probable volonté de sensibiliser les décideurs et d’ouvrir le débat au plus grand nombre, cette diffusion non vérifiée — de l’aveu même d’Elizondo — risque toutefois d’avoir l’effet inverse. En affaiblissant la crédibilité du message porté, elle offre une prise facile à ceux qui cherchent à discréditer l’ensemble des travaux présentés lors de l’événement.

Distorsion mnésique et contagion sociale

La mémoire, elle aussi, participe à l’élaboration subjective du réel. Loin d’enregistrer fidèlement le passé, elle le reconstruit à chaque rappel. Ce processus est influencé par le contexte, les émotions, les attentes ou des informations survenues après l’événement. Ainsi, ce que nous croyons nous souvenir peut être une version ajustée et parfois déformée de l’expérience initiale.

Exemple : des témoins d’un même événement peuvent, après en avoir discuté entre eux, voir leur souvenir s’aligner sur une version dominante, même si elle est erronée.

En outre, comme l’a montré la chercheuse Diana Pasulka dans son ouvrage American Cosmic, les récits médiatiques, les croyances religieuses, la culture populaire et les technologies numériques façonnent un environnement cognitif où la frontière entre fait, interprétation et projection devient floue. La croyance collective s’imprime alors dans la mémoire individuelle comme un souvenir sincère, mais reconstruit.

Afin d’assurer notre survie, nous n’avons pas besoin de percevoir tous les aspects de notre environnement, mais seulement ce qui suffit à orienter nos actions. C’est le prix de l’efficacité. Ce que nous appelons réalité est, par conséquent, le fruit d’une transformation progressive, opérée par nos filtres, nos biais, notre culture, nos souvenirs reconstruits et nos émotions. Le produit de ce mécanisme est une vérité illusoire, façonnée pour être cohérente et fonctionnelle.

Une crise de la preuve visuelle

Nous avons vu combien l’univers perceptuel de chacun est filtré, biaisé et reconstruit par nature. À ces vulnérabilités cognitives s’ajoute désormais une menace technologique. Dans un monde saturé d’images, la preuve visuelle, autrefois centrale, a perdu sa valeur démonstrative. À l’ère de l’intelligence artificielle, il est devenu possible de générer des vidéos, des voix ou des visages crédibles en quelques secondes. Les deepfakes ne sont plus une curiosité technique, mais un facteur de soupçon permanent. Une vidéo peut désormais être authentifiée par une autorité et pourtant considérée comme suspecte, simplement parce que l’œil humain ne suffit plus à trancher. La preuve visuelle est devenue structurellement vulnérable, l’image seule ne certifie plus rien.

Dans l’étude contemporaine des phénomènes aérospatiaux non identifiés, cette réalité impose une exigence nouvelle. Tout enregistrement visuel doit désormais s’appuyer sur des données convergentes issues d’autres sources, moins sujettes à la manipulation ou à l’ambiguïté.

Quand nos failles deviennent des cibles : vers une exploitation stratégique des biais cognitifs

Si ces biais et distorsions perceptives relèvent d’un fonctionnement cognitif normal, ils peuvent aussi être délibérément exploités. Les mécanismes psychologiques qui façonnent notre réalité individuelle constituent également des leviers puissants pour orienter la perception collective.

Des agences gouvernementales ont d’ailleurs cherché à exploiter systématiquement ces vulnérabilités cognitives. Le projet MK-Ultra, mené par la CIA de 1953 à 1973 et révélé lors des auditions du Church Committee en 1975, visait précisément à développer des techniques de manipulation psychologique. Utilisant des drogues, la privation sensorielle et diverses formes de traumatismes psychologiques, ce programme illustre comment cette agence a tenté d’instrumentaliser les failles de la psyché humaine à des fins stratégiques. L’existence officielle d’unités dédiées aux opérations psychologiques au sein du Pentagone témoigne que cette approche demeure d’actualité.

Cette exploitation repose sur une connaissance fine des dynamiques attentionnelles, des croyances partagées et des circuits de viralité médiatique. Une fois ces mécanismes à l’œuvre, identifier ce qui est informatif ou fallacieux exige une vigilance constante, tant la vérité semble toujours glisser entre les lignes.

Du scepticisme méthodique au dogme scientiste

Les biais cognitifs que nous venons d’explorer révèlent la fragilité de nos processus perceptifs et interprétatifs. Face à ces limites, le scepticisme constitue un pilier de la méthode scientifique pour éviter ces écueils. Cette disposition d’esprit peut toutefois s’exprimer de manière constructive ou dogmatique, protégeant notre démarche de connaissance ou l’entravant selon la façon dont nous l’employons.

Le scepticisme scientifique procède par doute méthodique. Plutôt que d’accepter ou de rejeter par principe, il permet de suspendre provisoirement son jugement le temps d’examiner les données disponibles. Cette posture favorise une évaluation rigoureuse des faits et maintient l’ouverture nécessaire à la révision de nos conclusions.

Parmi les outils du sceptique figure le rasoir d’Ockham, principe selon lequel l’explication la plus simple est généralement préférable - mais, point capital, seulement si elle rend compte de l’ensemble des observations. Ce principe n’est pas absolu car la science accepte parfois des explications complexes quand la simplicité ne suffit pas à expliquer les phénomènes observés. La mécanique quantique ou la relativité générale, par exemple, sont des théories complexes devenues consensuelles car elles expliquent mieux les données que les modèles plus simples qui les ont précédées.

Scepticisme et biais de confirmation

L’analyse du cas d’Aguadilla par l’AARO (All-domain Anomaly Resolution Office), agence américaine du département de la Guerre chargée d’étudier les PAN - illustre une dérive dogmatique du scepticisme. Face à une vidéo infrarouge montrant un objet aux comportements qui semblent inexpliqués, le rapport officiel de l’AARO conclut immédiatement qu’il s’agit probablement de “lanternes célestes”. Une approche qui inverse la méthode scientifique en posant la conclusion avant l’analyse.

L’AARO ne présente aucune grille d’évaluation, aucun protocole de test des hypothèses, aucun critère de hiérarchisation des explications possibles. Cette opacité rend leur analyse non reproductible, non vérifiable et donc infalsifiable, soit l’antithèse de la démarche scientifique.

Une approche rigoureuse consisterait à établir d’abord les données robustes, puis à tester systématiquement chaque hypothèse prosaïque face à ces informations, en retenant celle qui explique la plus grande proportion d’observations. Dans le cas d’Aguadilla, cette méthode révèle que l’hypothèse des lanternes explique mal les échos radar détectés, l’absence de lâcher massif pourtant décrit comme “d’usage courant”, et le nombre d’objets observés. Au-delà de ces contradictions factuelles, le rapport présente un autre paradoxe méthodologique : comment déclarer un “cas résolu le 20 mars 2025” tout en admettant une “confiance modérée” dans cette résolution ?

Un autre exemple frappant concerne les analyses du debunker Mick West de vidéos divulguées entre 2007 et 2017 par d’anciens hauts responsables du Pentagone. Ces vidéos montrent des objets filmés par des avions de combat de l’US Navy dans les séquences FLIR1, GIMBAL et GOFAST, objets que le Pentagone a officiellement déclarés comme restant non identifiés. West, lui, propose des explications conventionnelles, attribuant ces phénomènes respectivement à un avion distant, un avion dont la rotation apparente serait un artefact de caméra, et un ballon météo. Face aux témoignages détaillés des pilotes et opérateurs radars impliqués, West les écarte simplement, déclarant que les “témoignages oculaires sont très difficiles à analyser car ils sont sujets aux erreurs d’observation et de mémoire”, préférant se concentrer uniquement sur les vidéos. Ces conclusions impliquent que des pilotes de chasse hautement entraînés, des opérateurs radar expérimentés, et l’ensemble du personnel du renseignement naval auraient collectivement confondu des objets prosaïques avec des phénomènes suffisamment extraordinaires pour que le Pentagone les classent officiellement comme non identifiés.

Ces exemples révèlent une dérive commune dans l’application du scepticisme scientifique. Plutôt que de procéder par examen méthodique de l’ensemble des données disponibles, l’AARO et Mick West privilégient des explications conventionnelles au détriment de la rigueur analytique. L’AARO illustre un manque de déontologie flagrant en commençant son rapport officiel par sa conclusion et en attribuant au cas le statut de “résolu” tout en reconnaissant avoir une confiance modérée dans sa conclusion, ce qui constitue une contradiction apparente. Mick West révèle un biais de confirmation systémique, sélectionnant soigneusement les données qui servent ses conclusions prosaïques tout en écartant celles qui les contredisent. Dans les deux cas, le processus analytique est inversé : au lieu d’examiner l’ensemble des données pour en déduire l’explication la plus cohérente, on part d’une hypothèse préétablie qu’on s’efforce ensuite de valider.

Cette dérive montre comment le scepticisme peut se transformer en dogme lorsqu’il sert davantage à confirmer des présupposés qu’à examiner rigoureusement les données disponibles. Une approche scientifique authentique exigerait au contraire de reconnaître honnêtement les limites de nos explications actuelles face à des données qui ne s’y conforment pas entièrement.

Ces considérations nous amènent à une question plus fondamentale sur la nature de la connaissance scientifique elle-même. Comment établir ce qui constitue une connaissance valide ? Cette question implique de comprendre la nature évolutive et provisoire de la vérité scientifique.

Epistémologie & vérité

Même lorsqu’ils sont scientifiques, nos outils ne sont pas des transmetteurs intégraux de la réalité. L’objectivité, en science, repose sur des protocoles, des seuils, et des interprétations. Elle n’est pas un reflet intégral du réel, mais un cadre rigoureux, construit pour en approcher une représentation cohérente, reproductible et toujours provisoire, afin d’établir la meilleure description disponible à un instant donné.

L’histoire des sciences regorge d’exemples de l’impermanence de la vérité scientifique. Le concept d’atome, imaginé dès l’Antiquité comme une unité indivisible de matière, a profondément évolué au fil des découvertes. La gravitation newtonienne, longtemps considérée comme universelle, a été complétée par la relativité générale, nécessaire pour décrire les phénomènes dans des conditions extrêmes. Même Einstein fut confronté au caractère évolutif de la science. Convaincu que l’univers devait être statique, il introduisit une constante dans ses équations pour accorder la réalité avec sa conviction. Cependant, les observations d’Edwin Hubble montrèrent que l’univers était en expansion. La constante fut alors abandonnée.

Toutefois, celle-ci fut à nouveau introduite en 1998 pour expliquer l’accélération de cette expansion. Elle est à présent attribuée à ce que l’on nomme énergie noire, une force hypothétique, à la nature totalement inconnue, qui constituerait près de 70 % de l’univers. À ses côtés, la matière noire, postulée pour expliquer la cohésion gravitationnelle des galaxies, en représenterait environ 25 %. Notre connaissance du monde repose donc sur une marge béante, puisque 95 % de la réalité n’est que supposé selon le modèle cosmologique standard, tant qu’il n’est pas réfuté ou complété.

Cependant, ce chiffre ne marque pas une limite. Il ouvre un espace immense, propice à l’exploration. Ce que nous ignorons encore n’est pas un vide, mais un champ d’opportunités pour élargir nos cadres, interroger nos certitudes, et accueillir l’inattendu. Certains phénomènes ou objets, comme ceux que l’on regroupe aujourd’hui sous le terme de PAN, surgissent précisément dans ces zones encore floues, aux frontières de notre compréhension.

Sérendipité et intuition

Certaines des plus grandes avancées scientifiques ne sont pas nées d’un protocole planifié, mais d’un mélange de curiosité et d’ouverture à l’inattendu.

Deux phénomènes se distinguent alors : l’intuition et la sérendipité.

L’intuition dont il est question ici constitue un processus cognitif subconscient fondé sur l’expertise acquise, à ne pas confondre avec le concept d’intuition tel que décrit en philosophie ou en métaphysique. La sérendipité correspond à la transformation d’une observation fortuite en découverte significative.

Les exemples suivants rappellent que la construction du savoir se manifeste occasionnellement par des détours imprévus.

Exemples de découvertes guidées par l’intuition

Albert Einstein et la relativité restreinte (1905)

En s’imaginant poursuivre un rayon de lumière, Einstein remet en cause la conception classique du temps et de l’espace. Cette intuition, née d’une simple image mentale, le conduit à formuler l’une des théories les plus révolutionnaires de la physique moderne.Watson et Crick et la structure de l’ADN (1953)

Watson et Crick ont proposé la structure en double hélice de l’ADN en combinant des données existantes, des règles chimiques et une intuition structurale forte. Leur hypothèse, formulée avant toute confirmation expérimentale, fut ensuite validée et devint un fondement de la biologie moderne.

Alfred Wegener et la dérive des continents (1912)

En observant la correspondance entre les lignes côtières des continents et les similitudes géologiques et fossiles de part et d’autre des océans, Alfred Wegener élabore dès 1912 la théorie de la dérive des continents. Intuitivement convaincu que les masses continentales avaient autrefois été réunies, il avance cette hypothèse sans pouvoir en démontrer les mécanismes physiques. Rejetée par la majorité de ses contemporains faute de preuves tangibles, sa théorie sera pourtant confirmée près de cinquante ans plus tard avec l’émergence de la tectonique des plaques, devenant un pilier de la géologie moderne.

Exemples de découvertes issues de la sérendipité

Alexander Fleming et la pénicilline (1928)

Alors qu’il étudiait la croissance des staphylocoques, Alexander Fleming remarqua qu’une moisissure avait empêché leur développement sur une culture oubliée. Il ne cherchait pas un antibiotique, mais sut reconnaître l’importance de cette anomalie, découvrant ainsi la pénicilline, une avancée majeure qui allait révolutionner la médecine.Penzias et Wilson et le fond diffus cosmologique (1965)

En tentant d’éliminer un bruit parasite sur une antenne radio, les deux ingénieurs découvrent par hasard le rayonnement fossile de l’univers, confirmation expérimentale du Big Bang.Wilhelm Röntgen et les rayons X (1895)

En travaillant sur des tubes cathodiques, Wilhelm Röntgen observe une lueur étrange sur un écran fluorescent. Il en déduit l’existence d’un rayonnement invisible, qu’il nomme rayons X, et qui deviendra le fondement de l’imagerie médicale.Henri Becquerel et la radioactivité (1896)

Henri Becquerel cherchait à reproduire une émission de rayons X à partir de sels d’uranium exposés à la lumière. Il découvrit que les plaques photographiques étaient altérées même sans exposition, mettant ainsi en évidence la radioactivité.Percy Spencer et le four à micro-ondes (1945)

En travaillant sur un magnétron destiné aux radars, Percy Spencer remarque qu’une barre de chocolat fond dans sa poche. Ce phénomène l’amène à explorer le potentiel culinaire des micro-ondes, aboutissant à l’invention du premier four du genre.

Ces exemples montrent que l’ouverture d’esprit, qu’elle se traduise par une intuition juste ou par l’attention portée à l’imprévu, peut jouer un rôle décisif dans l’émergence de nouvelles connaissances.

Quelles preuves, pour quel phénomène ?

Face à la complexité que représente l’étude des PAN, où les manifestations et les effets semblent défier les catégories classiques, il est permis de penser que les avancées les plus fécondes ne viendraient pas d’un seul domaine, mais peut-être de la convergence entre plusieurs sphères disciplinaires. Une approche holistique, intégrant sciences dures, sciences humaines et médecine, pourrait ouvrir la voie à une compréhension plus complète du phénomène, voire à des explications quant à sa nature.

Cette nécessité d’un cadre partagé est également soulignée par le rapport Sky Canada publié en 2025 par le Bureau du conseiller scientifique en chef du Canada, qui appelle à une collaboration interdisciplinaire et internationale fondée sur des protocoles d’analyse rigoureux. Dans cet esprit, le modèle proposé par Jacques Vallée et Eric Davis, utilisé notamment dans le programme AAWSAP‑BAASS, offre une méthode de classification en six couches permettant d’étudier le phénomène selon six dimensions complémentaires :

la couche physique, qui regroupe les données matérielles et mesurables (traces au sol, perturbations électromagnétiques, émissions lumineuses, etc.) ;

la couche anti-physique, qui inclut les aspects rapportés comme contredisant les lois connues de la physique (changements de forme, disparition instantanée, temps manquant…) ;

la couche psychologique, centrée sur la manière dont les témoins perçoivent, interprètent et réagissent face à l’événement ;

la couche physiologique, qui concerne les effets sensoriels ou biologiques ressentis par les témoins pendant ou après l’expérience, ainsi que les résultats d’analyses médicales associées ;

la couche psychique, qui traite des interactions impliquant la conscience, les rêves ou les effets de type extra-sensoriel ;

la couche culturelle, qui analyse l’intégration du phénomène dans les récits, croyances, médias ou cadres religieux d’une société.

Ce modèle présente l’intérêt de ne pas exclure a priori une catégorie de données au profit d’une autre, mais propose de les considérer comme un tout articulé. Il offre une grille d’analyse multidimensionnelle, permettant d’organiser des indices hétérogènes selon des strates complémentaires, et de mieux cerner la complexité du phénomène.

Or, dans un champ encore balbutiant, cette structure pourrait offrir bien plus qu’un simple cadre de classement. Elle pourrait devenir le socle nécessaire à l’établissement de standards partagés entre les équipes et institutions engagées dans l’étude du phénomène. Car le consensus scientifique, condition d’admission d’un fait au sein de la connaissance collective, repose avant tout sur la reproductibilité des résultats : une observation ou une hypothèse n’a de valeur que si elle peut être reproduite, validée ou ? invalidée ? par d’autres.

Ce dernier point est fondamental. En science, une idée est robuste non pas parce qu’elle échappe à toute critique, mais parce qu’elle peut être testée, confirmée ou réfutée. Si une hypothèse ne peut être mise à l’épreuve, elle échappe à toute validation ou infirmation. Par exemple, la phrase « il existe une entité invisible qui contrôle tout mais qu’on ne peut ni voir ni mesurer » n’est ni mesurable ni falsifiable et n’est par conséquent pas scientifique. Non parce qu’elle est fausse, mais parce qu’elle est invérifiable. Or un changement de paradigme requiert la validation scientifique pour pouvoir être accepté et devenir une réalité.

À l’inverse, l’hypothèse suivante : « Il existe des objets dont les trajectoires présentent des accélérations instantanées incompatibles avec les lois actuelles de la physique » possède une valeur scientifique potentielle, précisément parce qu’elle est testable.

Le modèle en 6 couches Vallée-Davis, par sa conception interdisciplinaire et sa logique modulaire, offre un socle commun pour l’étude rigoureuse du phénomène. Il ne définit pas une méthode en soi, mais fournit un cadre analytique partagé, apte à organiser les données selon des catégories cohérentes. Il permet de collecter des observations comparables dans des formats harmonisés, d’ouvrir la voie à des méta-analyses transversales, et de créer un langage partagé entre disciplines. Cette interopérabilité est essentielle pour dépasser l’isolement actuel des approches, encore trop cloisonnées dans ce domaine d’études, et passer d’une accumulation de données disparates à une démarche cumulative, seule capable de générer un véritable corpus de connaissances.

Toutefois, un tel effort de convergence peut être difficile à mettre en œuvre. Même si la méthode scientifique repose sur des principes universels, les pratiques diffèrent sensiblement selon les contextes culturels, institutionnels ou techniques. L’harmonisation des méthodes, des formats et des outils exigera un engagement collectif. Ce prix est celui d’un progrès partagé. L’histoire montre que des erreurs graves peuvent résulter de l’absence d’un référentiel commun. En effet, en 1999, la sonde Mars Climate Orbiter de la NASA fut perdue à cause d’un simple défaut de conversion entre les systèmes de mesure. L’équipe de Lockheed Martin qui avait construit la sonde utilisait le système impérial, tandis que l’équipe du Jet Propulsion Laboratory responsable de la navigation utilisait le système métrique. Une coordination méthodologique fondée sur des standards clairs, est donc une condition préalable à toute avancée significative dans un domaine aussi complexe que celui dont traite cet article.

De la donnée à la responsabilité collective

Cette nécessité de standards partagés rejoint une réflexion méthodologique développée par Garry Nolan, Immunologiste de renommée internationale, professeur de pathologie à Stanford et inventeur prolifique., co-auteur du rapport scientifique “The New Science of UAP“ et conseiller des comités du renseignement du Sénat et de la Chambre des représentants, il a été contacté en 2013 par un ancien de la CIA et un cadre d’une entreprise aérospatiale. Sa mission consistait à analyser des problèmes médicaux touchant du personnel militaire et diplomatique - cas qui s’avéreront plus tard être parmi les premiers du syndrome de La Havane, officiellement reconnu depuis 2021 par le gouvernement américain qui indemnise désormais les victimes.

Lors d’une conférence au colloque Archives of the Impossible organisé à l’université Rice en avril 2025, le docteur Nolan développe sa vision scientifique de l’étude des PAN. Il établit une distinction fondamentale entre trois niveaux de progression des données vers la connaissance. Les données brutes correspondent aux observations directes et non traitées, comme les mesures radar ou les témoignages oculaires. Ces données constituent le matériau de base, mais demeurent sans signification tant qu’elles ne sont pas contextualisées. Les indices (que l’anglais distingue sous le terme evidence) représentent ces mêmes données une fois interprétées dans le cadre d’une hypothèse et d’une méthodologie rigoureuse. Les conclusions, enfin, correspondent aux interprétations explicatives que l’on peut tirer de ces indices après étude et analyse.

Cette distinction s’avère capitale, car il est en effet très facile de réfuter une conclusion, mais beaucoup plus difficile de contester des données vérifiables et une méthodologie reproductible. Comme l’a enseigné Jacques Vallée à Nolan, qui considère Vallée comme son mentor : “it’s the data, not the conclusion” (”ce sont les données [qui importent], pas la conclusion”). L’objectif premier n’est pas de valider une hypothèse particulière, mais d’établir la fiabilité des données recueillies. Selon Nolan, s’il parvient à convaincre un autre scientifique que les données sont authentiques et la méthodologie rigoureuse, alors la responsabilité d’interprétation devient collective.

Cette perspective précise également le rôle de l’évaluation par les pairs. Contrairement à l’idée reçue, ce processus ne vise pas à valider les conclusions d’une étude, mais à s’assurer de la validité méthodologique. Selon Nolan, l’important est que la méthode d’analyse soit reconnue comme rigoureuse, permettant ainsi aux conclusions d’être considérées comme recevables dans le contexte scientifique établi.

D’autre part, face aux critiques qui affirment qu’il n’y a pas de preuves, Nolan propose une réponse directe : “Quelle recherche avez-vous menée vous-même ?” Cette question révèle souvent que ceux qui nient l’existence d’indices n’ont en réalité effectué aucune investigation personnelle. Pour Nolan, de nombreux indices existent et sont largement accessibles, mais ils ne constituent évidemment pas des preuves irréfutables. Les preuves absolues sont selon lui rares en sciences et ne fonctionnent vraiment qu’en mathématiques. On pourrait ajouter le domaine juridique, où des preuves matérielles comme l’ADN peuvent établir de manière irréfutable la présence d’une personne sur une scène de crime. Dans les sciences expérimentales cependant, la rareté des preuves absolues découle de la nature même de la connaissance scientifique, par essence évolutive et provisoire.

Cette approche rappelle les fondements mêmes de la méthode scientifique, conçue pour éviter les biais de confirmation et les conclusions hâtives. Dans l’étude des PAN, où la nature extraordinaire des phénomènes rapportés peut conduire au rejet prématuré de données par refus de leurs implications potentielles, Nolan réaffirme simplement ces principes de base que certains académiques fermés d’esprit semblent avoir oubliés. Elle rejoint ainsi parfaitement l’esprit du modèle Vallée-Davis, qui propose d’organiser méthodiquement des données hétérogènes sans préjuger de leur interprétation finale.

Une application concrète : l’analyse de matériaux

Cette approche méthodologique trouve une application directe dans les travaux de Nolan sur l’analyse de matériaux d’origine présumée non humaine. S’appuyant sur des instruments avancés de tomographie atomique co-développés par son équipe à Stanford (MIBI-TOF), il examine des échantillons comme ceux du cas d’Ubatuba (1957, Brésil), où des pêcheurs avaient observé un disque volant exploser au-dessus de l’océan avant de récupérer des fragments de magnésium pur à 99,99%. Ces données matérielles constituent selon lui des indices troublants, notamment ce magnésium pur retrouvé sur le littoral brésilien dans les années 1950, un matériau d’origine exclusivement artificielle dont la présence à cet endroit et à cette époque demeure hautement improbable. Fidèle à l’enseignement de Vallée, Nolan s’abstient de donner des conclusions définitives sur l’origine de ces matériaux. Cependant, l’interprétation de ces résultats doit tenir compte du fait que les technologies d’analyse utilisées, bien qu’éprouvées dans le domaine biomédical, sont appliquées ici dans un contexte nouveau de forensique aérospatiale. Comme l’illustre leur propre analyse du cas de Council Bluffs, même avec des techniques analytiques avancées et des échantillons récupérés immédiatement après l’événement, l’interprétation définitive reste difficile. Cette extension d’usage nécessitera une validation spécifique et la reproduction des résultats par des équipes indépendantes utilisant des méthodes complémentaires.

Témoignages : une base pour la recherche

Le témoignage est reconnu comme un mode de preuve en droit. Dans le cas de l’étude des PAN, s’il ne constitue pas une validation scientifique, il demeure une pièce précieuse qui permet d’orienter l’analyse, de formuler des hypothèses et de signaler ce qui mérite d’être exploré.

Ce regard invite à reconsidérer l’immense corpus de témoignages existants. À titre d’exemple, le Mutual UFO Network (MUFON) dispose d’une base de données de plus de 140,000 cas documentés depuis 1969, tandis que le National UFO Reporting Center (NUFORC) en recense 180,000 depuis 1974.Trop souvent ignorés, marginalisés ou moqués, ces récits constituent pourtant un matériau brut d’une grande richesse. Cependant, cette stigmatisation n’est pas sans conséquence. Elle contribue probablement à la réticence de certains milieux académiques à s’engager dans l’étude de ces phénomènes.

Le cas du psychiatre John E. Mack est emblématique. Professeur à la Harvard Medical School et lauréat du prix Pulitzer, il a étudié les récits de possibles rencontres rapprochées et d’enlèvements par des entités non humaines. Sans surprise, ses travaux ont suscité une vive controverse, allant jusqu’à une enquête interne de l’université. Bien qu’il ait conservé son poste, cette affaire illustre la difficulté, même pour des chercheurs établis, à explorer des sujets en marge des paradigmes dominants sans risquer leur réputation.

Observations de masse et anomalies persistantes

Une catégorie particulière de témoignages mérite une attention accrue : celle des observations de masse. Ces événements rassemblent parfois des dizaines, voire des milliers de témoins décrivant l’observation d’un ou plusieurs PAN.

Le 27 octobre 1954 à Florence, des milliers de spectateurs d’un match de football au stade Artemio Franchi ont été témoins d’un objet se déplaçant lentement au-dessus du stade. Fait intriguant, certains témoins rapportent une forme de cigare, tandis que d’autres affirment qu’il avait une forme d’œuf. Son étrangeté amène les joueurs à interrompre la partie, médusés par ce qu’ils observent. De plus, une substance blanche et filamenteuse, surnommée “cheveux d’ange“, est tombée du ciel pendant l’observation. Cette matière a été analysée et s’est révélée contenir du bore, du silicium, du calcium et du magnésium, sans explication concluante sur son origine.

En 1966, à Westall, en Australie, plusieurs centaines d’élèves et d’enseignants ont observé un objet volant non conventionnel atterrir puis repartir.

En 1994, à l’école Ariel de Ruwa au Zimbabwe, 62 enfants ont raconté avoir vu un engin au sol ainsi que des êtres humanoïdes qui se seraient entretenus télépathiquement avec certains des enfants. Cette observation a notamment fait l’objet d’analyses psychologiques par le docteur Mack, qui conclut que les enfants étaient sincères et émotionnellement affectés. Selon lui, la réalité de leur expérience ne faisait aucun doute, sans signes de fabulation collective.

Le 13 mars 1997, plusieurs dizaines de milliers de témoins à travers l’Arizona et le Nevada ont observé ce qui est devenu l’un des événements ufologiques les plus documentés de l’histoire moderne, connu sous le nom de “Phoenix lights”. Entre 19h30 et 20h45, une formation en V de lumières d’une envergure estimée à plus d’un kilomètre a traversé le ciel, suivie d’orbes stationnaires. Parmi les premiers témoins figurait l’acteur Kurt Russell, pilote privé, qui rapporta les lumières au contrôle aérien alors qu’il approchait de Phoenix. Le gouverneur de l’Arizona Fife Symington, ancien capitaine de l’Air Force et pilote, tourna d’abord l’événement en dérision lors d’une conférence de presse en juin 1997, avant d’admettre dix ans plus tard avoir lui-même observé un engin qu’il qualifia comme provenant “d’un autre monde”. L’explication attribuant les observations à des fusées éclairantes militaires demeure contestée.

Ces témoignages massifs sont souvent écartés au nom de l’“hallucination collective”, mais cette hypothèse, bien que invoquée depuis longtemps, ne repose sur aucune démonstration scientifique. Aucun travail empirique n’a documenté l’existence d’une perception sensorielle partagée identique d’un objet inexistant, malgré plus d’un siècle de recherche extensive sur les hallucinations. Les cas souvent cités comme “hallucinations collectives” relèvent en réalité de phénomènes distincts tels que l’hystérie épidémique (ou maladie psychogénique de masse), caractérisée par la propagation de symptômes physiques comme les nausées, maux de tête ou évanouissements, par contagion émotionnelle, sans cause organique identifiable. Ces phénomènes diffèrent fondamentalement d’observations visuelles stables, détaillées et concordantes, rapportées a posteriori par des témoins indépendants ne se connaissant pas.

Analysés avec des outils contemporains, les témoignages pourraient pourtant constituer un socle heuristique fécond. L’intelligence artificielle, par exemple, pourrait faire émerger des motifs ou des régularités statistiques à partir de bases de données de témoignages, approche développée par Jacques Vallée dès les années 1960.

Lanceurs d’alerte et classification : quand la preuve reste inaccessible

Les témoins provenant des sphères militaires et du renseignement occupent une place unique dans ce corpus de données car leur statut institutionnel donne une crédibilité particulière à leurs révélations extraordinaires.

La nature des allégations varie selon leur exposition au phénomène. Certains affirment avoir eu un accès direct aux programmes de récupération et de rétro-ingénierie, communément appelés “legacy programs”, tandis que d’autres auraient obtenu des informations de seconde main par la consultation de documents classifiés, l’interrogatoire de témoins, ou l’accès à des briefings dans l’exercice de leurs fonctions. Cette position crée pour tous un même paradoxe où l’accès à des preuves sensibles s’accompagne de l’impossibilité de les partager intégralement.

David Grusch, le cas emblématique

David Grusch illustre parfaitement cette problématique. Ancien officier du renseignement décoré, vétéran de l’Afghanistan, il a servi quatorze ans dans l’US Air Force, où il a atteint le grade de Major. De 2019 à 2021, il était membre de l’UAPTF (Unidentified Aerial Phenomena Task Force) en tant que représentant du National Reconnaissance Office (NRO), travaillant au centre opérationnel sur le staff de briefing du directeur, ce qui inclut la coordination du rapport présidentiel quotidien (Presidential Daily Briefing) transmis à la Maison Blanche. De 2021 à 2023, en tant que civil, il a occupé un poste de niveau GS-15 (équivalent au grade de colonel) à la National Geospatial-Intelligence Agency (NGA), où il était le co-responsable de son agence pour l’analyse des PAN.

En raison de ses hautes fonctions, Grusch bénéficiait d’accréditations exceptionnelles. Cette position lui donnait accès “littéralement à tous les compartiments pertinents“ et constituait selon ses propres termes “une fonction impliquant une confiance absolue“ dans ses capacités militaires et civiles. En 2019, dans le cadre d’un mandat congressionnel, le directeur de l’UAPTF lui confie une mission cruciale, consistant à identifier tous les programmes d’accès spéciaux et programmes d’accès contrôlés (SAP/CAP) en activité au sein du Département de la Guerre. Dans le cadre de cette enquête officielle, il aurait interrogé une quarantaine de témoins de première main sur une période de quatre ans.

Ces témoins lui auraient alors révélé l’existence de récupérations clandestines d’engins et de ce qu’il qualifie de matériaux biologiques d’origine non humaine. Ces opérations s’inscriraient dans le cadre de programmes secrets de récupération et de rétro-ingénierie s’étendant sur plusieurs décennies. Plus grave encore, Grusch aurait découvert que ces programmes échapperaient à la surveillance du Congrès. Bien que les autorités compétentes puissent refuser le contrôle congressionnel pour certains programmes d’accès spéciaux sensibles (waived SAPs), les présidents et membres minoritaires des comités des forces armées et des crédits (Appropriations) du Congrès doivent au minimum être informés. Selon Grusch, ce n’était pas le cas pour ces projets secrets, confirmant leur caractère illégal selon les règles fondamentales du système démocratique américain qui veut que tous les programmes gouvernementaux soient soumis à une supervision du congrès. Malgré son haut niveau d’habilitation, Grusch se serait vu refuser l’accès à ces programmes qu’il aurait identifiés. Face à ces blocages et aux pressions subies, il a d’abord déposé une plainte auprès de l’Inspecteur Général de la Communauté du Renseignement (ICIG) en mai 2022. En juillet 2022, ce dernier a qualifié les allégations de David Grusch de “crédibles et urgentes“, une évaluation qui renforce considérablement la plausibilité de ses affirmations. Il a ensuite choisi de démissionner en 2023 pour pouvoir en parler publiquement en tant que lanceur d’alerte. Le 26 juillet 2023, il a témoigné sous serment lors d’une audition publique devant le sous-comité de sécurité nationale de la Chambre des représentants, considérant que de telles révélations devaient être portées à la connaissance de la population.

Les contraintes du processus DOPSR

Afin de dévoiler publiquement certaines de ces allégations explosives tout en s’assurant de ne pas être poursuivi pour divulgation d’informations sensibles, Grusch a dû soumettre ses déclarations au processus DOPSR (Defense Office of Prepublication and Security Review). Ce bureau examine tout matériel que d’anciens militaires ou agents du renseignement souhaitent publier, afin de s’assurer qu’aucune information classifiée ne soit divulguée au public et par la même occasion aux adversaires des Etats-Unis. L’objectif est de protéger les sources, méthodes et capacités du renseignement américain, ainsi que les technologies stratégiques susceptibles de conférer un avantage militaire.

Cette procédure obligatoire s’applique à tout ancien personnel ayant eu accès à des informations classifiées, même après la fin de leur service.

Dans le cas de lanceurs d’alerte comme Grusch, ils ne peuvent transmettre leurs informations classifiées qu’à des personnes possédant le même niveau d’habilitation et uniquement dans un SCIF (Sensitive Compartmented Information Facility). Ces espaces sécurisés, spécialement conçus pour les échanges d’informations sensibles, sont isolés de toute surveillance électronique et équipés de protections contre l’espionnage.

Cette architecture sécuritaire pose un défi majeur pour toute vérification publique. Grusch prétend pouvoir indiquer les lieux précis d’entreposage d’objets d’origine non humaine, mais ne peut en fournir la preuve qu’en respectant des protocoles strictement encadrés. Ses affirmations échappent ainsi au contrôle citoyen et scientifique traditionnel. À ce jour, ce même processus DOPSR ne lui a toujours pas accordé l’autorisation de révéler publiquement en quoi il se considère comme un témoin de première main, maintenant ainsi le mystère sur les fondements de ce statut qu’il revendique.

Tensions entre secret et transparence

Cette architecture sécuritaire pose des défis qui vont bien au-delà de la simple vérification publique. Le parcours de Grusch illustre les risques personnels encourus par ces témoins. Suite à ses révélations, il a déclaré avoir subi des représailles : fuite de son dossier médical, menaces ou encore perte de certains droits de vétéran. Ce climat dissuasif explique la réticence d’autres témoins potentiels, qui préfèrent témoigner à huis clos ou garder le silence.

Jacob Barber, ancien militaire des forces spéciales devenu contractant privé pour des entreprises du complexe militaro-industriel américain, affirme avoir été impliqué dans des programmes de récupération d’engins d’origine non humaine. Son témoignage révèle un paradoxe saisissant : sollicitant la protection de hauts responsables, il s’est vu demander... de les protéger lui-même. Cette inversion des rôles en dit long sur l’inquiétude qui gagne les plus hauts échelons face à ce sujet sensible.

Cette compartimentalisation s’est encore renforcée ces dernières années. Selon un rapport du lanceur d’alerte Matthew Brown, divulgué en 2024, il existerait depuis 2017 un programme secret baptisé Immaculate Constellation, doté de systèmes automatisés de détection et de mise en quarantaine de toute donnée liée aux PAN, empêchant leur circulation normale au sein même de l’appareil de renseignement. Ces mécanismes de classification automatique développés par le Département de la Guerre illustrent l’ampleur des obstacles structurels que l’exécutif oppose aux efforts de transparence menés par une partie du Congrès.

Vers une divulgation contrôlée ?

Face aux blocages systémiques révélés par l’affaire Grusch et les dysfonctionnements du système actuel, une réponse d’ampleur inédite a émergé au sein du Congrès américain. L’Unidentified Anomalous Phenomena Disclosure Act (UAPDA), porté par les sénateurs Chuck Schumer et Mike Rounds, représente un tournant majeur dans l’approche législative de la question de la preuve concernant les PAN.

La loi établit que tous les documents gouvernementaux concernant les PAN sont considérés comme déclassifiables par défaut, sauf justification contraire. L’inversion de la charge de la preuve est totale, puisque ce n’est plus au public de justifier pourquoi l’information devrait être accessible, mais aux agences gouvernementales de démontrer pourquoi elle doit rester classifiée.

Le texte introduit massivement le terme d’« intelligence non humaine » (NHI), une formulation qui témoigne de l’évolution conceptuelle du débat au plus haut niveau de l’État américain. Cette terminologie, utilisée 22 fois dans ce texte législatif, révèle que la question ne se limite plus aux PAN mais englobe désormais explicitement l’hypothèse d’une origine intelligente non humaine.

Un processus d’affaiblissement révélateur

L’histoire de cette législation révèle cependant un processus d’érosion progressive qui illustre parfaitement les résistances structurelles à toute forme de transparence sur ce sujet. La version originale de 2023 prévoyait la création d’un comité d’examen indépendant, composé de neuf experts nommés par le président et confirmés par le Sénat, avec un budget de 20 millions de dollars. Ce comité aurait disposé de pouvoirs considérables, notamment l’accès à tous les programmes classifiés, le pouvoir de citation à comparaître, et même le droit de saisie sur les “technologies récupérées d’origine inconnue“ détenues par des entités privées.

Cette version ambitieuse s’est heurtée à une coalition d’opposition menée par le représentant Mike Turner, alors président du comité du renseignement de la Chambre, et Mike Rogers, président du comité des services armés. Or, ces deux représentants ont reçu des centaines de milliers de dollars de contributions de la part des contractants de la défense qui auraient été directement affectés par la loi. Ces liens financiers créent un conflit d’intérêt structurel évident avec des entreprises qui auraient dû céder leurs « technologies d’origine inconnue » selon les dispositions originales de la loi.

L’opposition de Lockheed Martin prend tout son sens quand on considère les allégations du sénateur Harry Reid, décédé en 2021. Ce dernier affirmait avoir été “informé pendant des décennies que Lockheed détenait certains de ces matériaux récupérés”. Malgré sa position de leader de la majorité au Sénat, Reid s’est vu refuser par le Pentagone l’autorisation d’inspecter ces matériaux présumés. Si de telles technologies existent effectivement dans les installations de Lockheed Martin, l’UAPDA et son pouvoir de confiscation représenteraient une menace existentielle pour le contrôle privé de ces technologies potentiellement révolutionnaires.

Parallèlement, le Pentagone et l’AARO ont mené leur propre campagne d’opposition à l’UAPDA. Sean Kirkpatrick, ancien directeur de l’AARO, a confirmé que son bureau s’était opposé aux dispositions clés de l’amendement, prétextant une duplication des missions déjà assignées à l’AARO par le Congrès. Cette opposition révèle un paradoxe saisissant. L’agence chargée d’enquêter sur les allégations de dissimulation gouvernementale s’oppose à la création d’un mécanisme de supervision indépendant.

En 2024, seuls quelques éléments superficiels de l’UAPDA ont été intégrés au NDAA, créant une simple base de données de documents vidée de sa substance originelle. Suppression complète d’un comité d’examen indépendant, suppression du droit de réquisition, remplacement par une simple centralisation de documents relatifs aux PAN administrée par les Archives Nationales. Le pouvoir de divulgation restait aux mêmes agences qui avaient organisé la dissimulation pendant des décennies.

Ce processus d’affaiblissement se poursuit. En 2025, Schumer et Rounds ont de nouveau déposé l’UAPDA dans sa version complète comme amendement au NDAA (National Defense Authorization Act, la loi annuelle de programmation militaire définissant le budget et les politiques de défense) 2026, réintroduisant le comité d’examen indépendant et le droit de confiscation. Cette persistance législative témoigne de la conviction des sénateurs qu’un mécanisme de divulgation contrôlée reste nécessaire, malgré les résistances institutionnelles et privées qui ont sabordé les versions précédentes.

Cependant, cette architecture institutionnelle révèle également les limites intrinsèques de toute divulgation contrôlée. Le président conserve un droit de veto sur les décisions du comité, et les documents les plus sensibles peuvent voir leur déclassification reportée jusqu’à 25 ans après leur création. La divulgation reste donc subordonnée à l’appréciation souveraine du pouvoir exécutif.

Cette évolution législative représente parfaitement la tension fondamentale au cœur de la problématique de la preuve dans le domaine des PAN. D’un côté, elle reconnaît institutionnellement la légitimité de la demande de transparence et la nécessité de soumettre tous les programmes gouvernementaux à une supervision du Congrès. De l’autre, elle révèle l’ampleur des résistances que suscite cette exigence démocratique élémentaire.

L’intensité même de cette opposition interroge. Si les PAN ne représentaient réellement qu’une succession de méprises et de phénomènes naturels mal interprétés, l’opposition systématique à leur étude transparente semble disproportionnée. Cette résistance à toute forme de supervision indépendante suggère l’existence d’informations que certains acteurs jugent nécessaire de protéger, qu’il s’agisse de programmes conventionnels classifiés, de technologies avancées, ou d’autres éléments relevant de la sécurité nationale.

L’échec répété de ces tentatives de transparence révèle également les mécanismes par lesquels des intérêts privés peuvent s’approprier le processus démocratique. Le phénomène de “porte tournante” entre le Pentagone et les contractants de la défense cristallise cette emprise systémique. En 2024, près de 70% des lobbyistes de Lockheed Martin étaient d’anciens officiels gouvernementaux, une situation qui facilite l’influence sur les décisions politiques. Dans un tel contexte, la distinction entre intérêt public et intérêt privé s’estompe, rendant toute supervision indépendante difficile à établir.Les pionniers d’une investigation moderne

Longtemps marginalisée, l’étude des phénomènes aérospatiaux non identifiés connaît aujourd’hui un renouveau marqué par l’émergence d’initiatives ambitieuses menées par des chercheurs et organisations scientifiques dans le monde entier.

Sur le plan technologique, les projets Galileo (Avi Loeb, Harvard) et Skywatch (Mitch Randall) développent des systèmes de détection spécialement conçus pour tester des hypothèses audacieuses, comme l’existence d’objets présentant des accélérations instantanées incompatibles avec les lois physiques actuelles. Galileo déploie des observatoires multimodaux équipés d’intelligence artificielle pour identifier automatiquement les PAN, tandis que Skywatch propose la création d’un réseau national de radars passifs utilisant les signaux des avions commerciaux comme référence de calibration continue.

Parallèlement, des organisations comme UAPx et la Scientific Coalition for UAP Studies produisent des analyses scientifiques. La SOL Foundation, cofondée par Garry Nolan, adopte une approche complémentaire en organisant des conférences publiques et en stimulant la recherche académique interdisciplinaire, notamment dans le domaine de l’analyse de matériaux potentiellement anormaux.

Le projet VASCO (Dr. Beatriz Villarroel) propose une démarche particulièrement originale en analysant un siècle de plaques photographiques astronomiques pour identifier des sources transitoires inexpliquées. L’équipe du docteur Villarroel a publié des résultats troublants révélant plus de 100 000 objets transitoires candidats dans les images du Palomar Sky Survey des années 1950, antérieures aux premiers satellites artificiels, incluant des journées avec plusieurs milliers de détections. Leurs découvertes de “transits multiples” alignés, coïncidant avec des événements historiques comme les observations de Washington D.C. en juillet 1952, soulèvent des questions fascinantes.

En étudiant des plaques photographiques astronomiques datant d’avant l’ère spatiale, le projet VASCO (Dr. Beatriz Villarroel) a identifié des objets inexpliqués. Le 20 octobre 2025, l’équipe a publié dans Scientific Reports (portfolio Nature) une étude peer-reviewed révélant plus de 100 000 transits de nature inconnue, observés avant le lancement du premier satellite artificiel. L’étude met également en évidence des corrélations statistiquement significatives entre ces transitoires et les essais nucléaires atmosphériques ainsi que les vagues d’observations de PAN de l’époque.

Ces initiatives révèlent cependant un paradoxe. Alors que la recherche se structure et se professionnalise, ces projets fonctionnent encore largement en silos. Comme suggéré précédemment, une coordination entre ces équipes permettrait de partager les protocoles, standardiser les formats de données et mutualiser les découvertes pour optimiser leurs travaux et favoriser la recherche dans tous les domaines couverts par le phénomène.

Néanmoins, l’émergence de ces multiples initiatives témoigne d’un changement fondamental. Pour la première fois dans l’histoire de ce sujet, des scientifiques équipés d’outils modernes s’attaquent méthodiquement à cette énigme. Qu’il s’agisse de détecter des trajectoires impossibles, d’analyser des données historiques ou de croiser les disciplines, ces pionniers construisent les fondations d’une approche rigoureuse, peut-être un jour capable de répondre enfin à la question fondamentale : où sont les preuves ?

L’annexe propose une liste plus complète, bien que non exhaustive, des initiatives actuelles.

La preuve du mystère

L’analyse du cas Rubber Duck illustre un paradoxe fascinant. Une étude scientifique peut démontrer qu’un phénomène observé demeure inexpliqué, même après une investigation approfondie. En 2022, la Scientific Coalition for UAP Studies (SCU) a publié une analyse détaillée d’une vidéo infrarouge enregistrée le 23 novembre 2019 par un avion RC-26B de la Garde nationale de l’Arizona, au-dessus de la réserve naturelle de Buenos Aires National Wildlife Refuge.

L’objet observé présente des caractéristiques singulières. L’analyse cinématique montre qu’il effectue des rotations régulières pendant environ trente minutes, suivant une trajectoire stable et cohérente, incompatible avec le comportement d’un objet entraîné par le vent. En effet, les données météorologiques indiquent que les vents locaux oscillaient entre 3 et 45 mph (5 - 72 km/h) selon l’altitude, avec un maximum de 33 mph (53 km/h) au niveau de vol auquel se trouvait l’avion de la Garde nationale. Or, les calculs de vitesse tangentielle démontrent qu’à toutes les altitudes enregistrées, l’objet se déplaçait plus rapidement que le vent, ce qui exclut l’hypothèse d’un ballon porté par les courants atmosphériques.

L’analyse infrarouge révèle que l’objet ne semble émettre aucune chaleur propre. Selon la SCU, cette impression résulte à la fois du fonctionnement du capteur FLIR et du caractère possiblement réfléchissant de la surface de l’objet, qui renverrait la température du ciel ou de l’atmosphère environnante. Ce comportement thermique est incompatible avec les systèmes de propulsion connus.

L’examen méthodique des hypothèses conventionnelles conduit à un constat déroutant. Le ballon météorologique en latex est écarté, car ce matériau est transparent aux infrarouges et transmettrait la température du sol. Le ballon métallisé de type Mylar est également rejeté, puisque celui-ci éclate entre 3 000 et 8 000 pieds d’altitude. L’hypothèse d’un drone ne résiste pas davantage. Les modèles à propulsion électrique disposent d’une autonomie bien inférieure à la durée d’observation, estimée à plus de quarante-cinq minutes, tandis que ceux à moteur thermique produisent une signature infrarouge nettement visible, absente ici. De plus, la forme de l’objet ne correspond à aucun type de drone connu. L’objet, d’une taille estimée entre 1 et 9 pieds (30 à 275 cm), conserve une forme rigide et régulière, sans aucune structure aérodynamique apparente.

Au terme de cette analyse, les chercheurs de la SCU concluent que les explications connues ne permettent pas de rendre compte des observations. L’objet ne correspond à aucun phénomène naturel identifié ni à aucune technologie de propulsion répertoriée. Il demeure donc classé comme un phénomène aérien non identifié, réel et digne d’étude scientifique.

Conclusions

La question “où sont les preuves ?” résonne légitimement face aux phénomènes aérospatiaux non identifiés. Pourtant, cette exigence apparemment simple se heurte à une réalité complexe. Nos outils perceptifs et conceptuels, forgés pour assurer notre survie, peinent à appréhender des manifestations qui défient nos catégories établies. L’analyse du cas Rubber Duck par la SCU illustre cette difficulté : en démontrant méthodiquement l’inadéquation des explications conventionnelles, elle établit les limites de notre compréhension sans pouvoir identifier le phénomène observé.

Cette situation appelle une révision de notre approche. Plutôt que de chercher une preuve définitive qui résoudrait la question de manière absolue, l’étude rigoureuse des PAN exige le déploiement d’une écologie de la preuve, en articulant des types de données différents en un ensemble cohérent et évolutif. Des pistes méthodologiques prometteuses émergent, du modèle interdisciplinaire de Vallée-Davis aux projets technologiques comme les réseaux de radars passifs Skywatch, qui permettraient d’établir une approche scientifique standardisée et reproductible.

Cependant, cette recherche se heurte à des résistances qui rappellent l’histoire tragique des révolutions scientifiques. Giordano Bruno fut brûlé vif en 1600 pour avoir entre autres défendu l’infinité de l’univers. Galilée échappa de peu au même sort sous la menace de l’Inquisition. Ses contemporains peinaient à concevoir que la Terre ne fût pas le centre de l’univers, une idée pourtant si évidente aujourd’hui qu’elle nous semble triviale.

L’engagement des scientifiques dans ce domaine encore marginalisé demeure essentiel. Comme le rappelle Thomas Kuhn, « la découverte commence avec la reconnaissance de l’anomalie ». Si des données probantes venaient à confirmer l’existence de phénomènes échappant à notre compréhension actuelle, cela ne signifierait pas la fin du mystère, mais son déplacement vers des questions encore plus fondamentales.

Car il faut garder à l’esprit une vérité vertigineuse. Nous évoluons dans l’illusion de percevoir la réalité alors que nous n’en saisissons qu’une infime fraction. Ce que nous appelons “réalité” n’est qu’une construction subjective, tragiquement partielle, de ce qu’est notre monde.

L’humilité imposée par les limites de notre connaissance rejoint l’enseignement intemporel de Socrate qui, il y a plus de deux millénaires, avait déjà saisi ce principe fondamental : “Je sais que je ne sais pas“. Cette reconnaissance de notre ignorance, loin d’être une faiblesse, constitue le fondement même de toute démarche scientifique authentique. Comme le souligne la chercheuse Diana W. Pasulka, Socrate était reconnu comme l’homme le plus intelligent de son époque, non parce qu’il prétendait tout savoir, mais précisément parce qu’il avait conscience de son ignorance. Elle ajoute que “cette posture d’ouverture et de réception permet à la connaissance de nous trouver, plutôt que de nous enfermer dans nos certitudes”.

Ce constat ouvre un horizon immense. L’univers recèle probablement des mystères que nos instruments ne nous permettent même pas d’effleurer. Les PAN nous invitent à cultiver cette curiosité fondamentale qui pousse l’humanité à explorer l’inconnu et à chercher au-delà des limites apparentes. C’est dans cette quête, guidée par la rigueur et nourrie par l’émerveillement, que pourrait se dessiner l’avenir de notre compréhension du cosmos.

ANNEXE

Organisations étudiant le phénomène (liste non exhaustive - merci de contacter la rédaction si vous souhaitez ajouter une organisation ou corriger une information)

A. Organisations gouvernementales

Type : Service officiel gouvernemental. Domaine : Analyse des témoignages et cas rapportés sur le territoire français. Couche(s) : Physique + Psychologique (témoignages + éléments matériels). Production : Analyses officielles publiées.

B. Organisations académiques et programmes de recherche universitaire

Type : Programme de recherche académique. Domaine : Observatoires automatisés. Couche(s) : Physique (détection multimodale continue). Spécificité : Intelligence artificielle pour identification automatique. Production : Le projet a commencé à publier ses premières données d’observation en 2024, avec un observatoire opérationnel surveillant en continu le ciel de Harvard.

Type : Programme de recherche astronomique. Domaine : Analyse d’archives historiques. Couche(s) : Physique (sources transitoires sur plaques photographiques). Spécificité : Approche historique sur plus d’un siècle de données. Production : Identification de sources transitoires inexpliquées.

Type : Institut de recherche universitaire. Domaine : Détection et analyse IA. Couche(s) : Physique + Culturelle (détection + recherche vie extraterrestre). Spécificité : Double approche terrestre (Sky-CAM) et spatiale (SONATE). Production : Analyses par intelligence artificielle.

SUAPS (Society for UAP Studies)

Type : Société académique. Domaine : Publication et formation universitaire. Couche(s) : Culturelle + Psychologique (intégration académique). Spécificité : Revue académique à comité de lecture dédiée exclusivement aux PAN. Production : Revue Limina et cursus universitaires.

C. Organisations privées et centres de recherche

Americans for Safe Aerospace (ASA)

Type : Organisation civile à but non lucratif dirigée par d’anciens militaires. Domaine : Sécurité aérienne et soutien aux témoins. Couche(s) : Psychologique + Culturelle (témoignages confidentiels + plaidoyer législatif). Spécificité : Collecte de témoignages de pilotes civils et militaires - Plus de 30,000 membres. Production : Témoignages centralisés et plaidoyer législatif (ex: Safe Airspace for Americans Act).

Type : Organisation de recherche privée. Domaine : Instrumentation scientifique de terrain. Couche(s) : Physique (capteurs infrarouges, optiques, magnétiques, radiatifs). Production : Publications scientifiques à comité de lecture.

Scientific Coalition for UAP Studies (SCU)

Type : Organisation scientifique indépendante. Domaine : Analyse de cas complexes. Couche(s) : Physique (données physiques croisées). Production : Rapports d’analyse scientifique (ex: cas “Rubber Duck”).

Type : Organisation civile internationale de recherche et d’enquête. Domaine : Investigation de terrain et base de données globale. Couche(s) : Physique + Psychologique + Culturelle (témoignages détaillés + analyses multidisciplinaires + archives historiques). Spécificité : Plus de 4000 enquêteurs formés dans le monde entier, système de classification standardisé, base de données de plus de 140,000 cas depuis 1969. Production : Rapports d’enquête standardisés, revue mensuelle “MUFON Journal”, symposium annuel international.

Type : Organisation civile indépendante à but non lucratif. Domaine : Collecte et archivage de signalements. Couche(s) : Psychologique + Culturelle (témoignages + analyses statistiques). Spécificité : Base de données publique de plus de 180,000 rapports de témoins depuis 1974. Production : Signalements centralisés, analyses statistiques périodiques, service de signalement téléphonique 24/7.

Type : Centre de recherche spécialisé. Domaine : Sécurité aérienne. Couche(s) : Physique + Physiologique (effets électromagnétiques + impacts sur pilotes). Spécificité : Focus unique sur les interactions PAN-aviation. Production : Rapports techniques et analyses interdisciplinaires.

Type : Commission d’experts interdisciplinaire. Domaine : Analyse scientifique des cas inexpliqués. Couche(s) : Physique + Physiologique (capteurs multiples + effets biologiques). Spécificité : Une vingtaine d’experts civils et militaires de domaines variés (aéronautique, radar, physique, biologie, psychologie). Production : Études scientifiques interdisciplinaires.

Type : Fondation académique interdisciplinaire. Domaine : Recherche académique et politique publique. Couche(s) : Culturelle + Psychologique (implications sociétales + perception). Spécificité : Approche politique et philosophique des intelligences non-humaines. Production : Conférences publiques et recherche académique.

Type : Service d’information multilingue et centre de recherche privé. Domaine : Médiatique; scientifique. Couche(s) : Culturelle + Physique (information publique + détection). Spécificité : Observatoire mobile Production : Service d’information multilingue (Sentinel News).

Type : Projet technologique. Domaine : Détection radar passive. Couche(s) : Physique (détection d’objets en réseau). Spécificité : Calibration continue automatique via signaux ADSB. Production : Système de détection reproductible et contrôlé.

Type : Organisation historique civile. Domaine : Documentation et archives. Couche(s) : Culturelle + Psychologique (préservation témoignages + coordination civile). Spécificité : Organisation de référence historique depuis 1956. Production : Archives chronologiques et coordination d’enquêtes.

Type : Chercheurs indépendants. Domaine : Recherche de terrain académique. Couche(s) : Physique + Psychologique (données instrumentées + témoignages). Spécificité : Focus géographique sur Long Island, approche peer-reviewed. Production : Publications académiques et livre “Nightcrawler: Eye on the Sky”.

Type : Programme de recherche spatiale. Domaine : Détection d’objets artificiels orbitaux. Couche(s) : Physique (réseau de télescopes). Production : Méthodologie de détection (évaluation en cours).

D. Entreprises commerciales

Type : Entreprise privée. Domaine : Approche hybride technologie-parapsychologie. Couche(s) : Physique + Psychique + Culturelle (technologie + phénomènes de conscience + taxonomie). Spécificité : Objectifs d’atterrissage contrôlé et classification des PAN. Production : Méthodologie hybride (non basée sur standards scientifiques, en date du 13/10/2025).